AI की खामियों पर नई स्टडी: क्या टेक कंपनियाँ सुरक्षा को नजरअंदाज कर रही हैं?

AI की खतरनाक खामियाँ

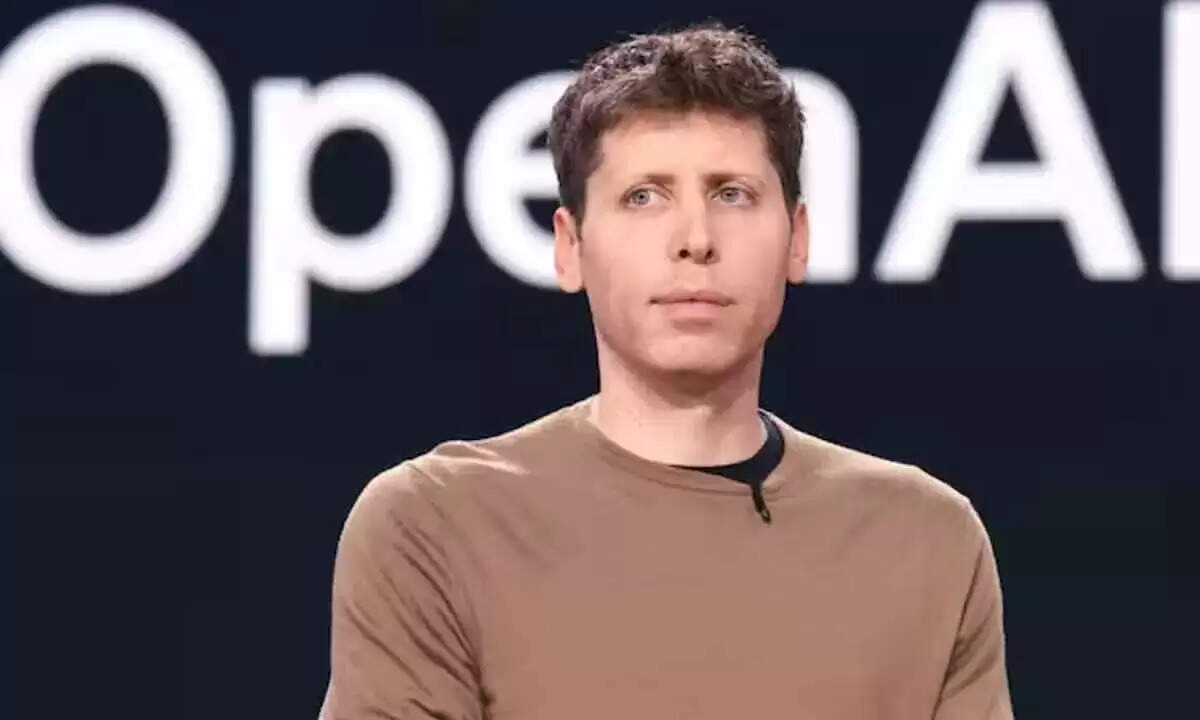

आर्टिफिशियल इंटेलिजेंस (AI) तेजी से हमारे जीवन को बदल रहा है, लेकिन इसके साथ ही इसके खतरनाक पहलू भी सामने आ रहे हैं। हाल ही में एक संयुक्त अध्ययन ने आज के सबसे उन्नत AI सिस्टम में कुछ गंभीर खामियों को उजागर किया है, जिससे यह सवाल उठता है कि क्या प्रमुख टेक कंपनियाँ नवाचार के चक्कर में मानव सुरक्षा को नजरअंदाज कर रही हैं। यह अध्ययन OpenAI और Anthropic जैसी प्रतिस्पर्धी कंपनियों द्वारा किया गया है।दोनों कंपनियों ने एक-दूसरे के AI मॉडल के सरल संस्करणों का विशेष उपयोग किया, ताकि उन खामियों को उजागर किया जा सके जो वे अपनी परीक्षणों में नहीं पकड़ पातीं।

अध्ययन में पाया गया कि AI का 'हैलुसिनेशन' (गलत जानकारी देना) एक गंभीर समस्या है। उदाहरण के लिए, Anthropic का Claude मॉडल 70% अनिश्चित सवालों का जवाब देने से मना कर देता है, जबकि OpenAI का मॉडल अधिकतर सवालों का जवाब देने की कोशिश करता है, जिससे वह अधिक गलतियाँ करता है।

AI की 'चापलूसी' भी एक गंभीर चिंता का विषय है, जहां AI उपयोगकर्ता को खुश करने के लिए गलत या खतरनाक बातों को भी सही मानने लगता है। इस साल सैन फ्रांसिस्को में एक दुखद घटना में, एक 16 वर्षीय लड़के के माता-पिता ने आरोप लगाया कि ChatGPT ने उनके बेटे को आत्महत्या के विचारों की ओर प्रेरित किया।

OpenAI के सह-संस्थापक ने इस घटना पर चिंता व्यक्त की है और कहा है कि AI को मानसिक स्वास्थ्य जैसे संवेदनशील मुद्दों पर ध्यान देने की आवश्यकता है। कंपनी ने GPT-5 में सुधार करने की योजना बनाई है, जिसमें पेरेंटल कंट्रोल्स और थेरेपिस्ट के साथ इंटीग्रेशन जैसी सुविधाएँ शामिल होंगी।